¿Qué es la linealidad en estadística? ¿Alguna vez observaste un diagrama de dispersión y notaste un patrón que parece formar una línea recta? Ahí es donde la linealidad en estadística entra en juego. En este artículo, exploraremos qué significa la linealidad, cómo verificarla, y su importancia en el análisis de regresión, la correlación y otros métodos estadísticos.

Los Fundamentos: ¿Qué es la Linealidad en Estadística?

La linealidad en estadística se trata de relaciones. Pero no cualquier relación, sino aquellas donde un cambio en una variable corresponde directamente a un cambio en otra variable. Imagina una línea recta conectando dos puntos en un gráfico; esa es una relación lineal en acción: cuanto más recta sea la línea, más "lineal" es la relación entre las variables.

Un ejemplo sencillo de relación lineal es la conexión entre la distancia que recorres y el tiempo que tardas en llegar. Si viajas a velocidad constante, la relación entre distancia y tiempo será lineal, lo que significa que si duplicas el tiempo, también duplicarás la distancia.

Al trabajar con linealidad en estadística, frecuentemente representamos la relación entre variables usando una ecuación lineal. En el caso más simple, con dos variables (x e y), la relación lineal se puede representar con la ecuación:

Aquí, representa la pendiente (tasa de cambio) de la línea, es la intersección en y (el valor de y cuando ), y e son las variables independiente y dependiente, respectivamente. Puedes pensar en la pendiente como la "inclinación" de la línea, mientras que la intersección en y es donde la línea cruza el eje vertical.

Veamos un ejemplo. Supongamos que quieres predecir el precio de una pizza según su tamaño (en pulgadas). Recopilas algunos datos y descubres que la relación entre el tamaño () y el precio () es lineal, con una pendiente () de 2 y una intersección en y () de 5. Tu ecuación lineal se vería así:

Ahora, si quieres calcular el precio de una pizza de 12 pulgadas, sustituye el valor de :

Entonces, una pizza de 12 pulgadas costaría $29.

¿Por Qué Nos Importa la Linealidad?

La linealidad es la base de muchas técnicas estadísticas que nos ayudan a entender tendencias, patrones y relaciones entre variables. Es vital en campos como las ciencias sociales, la economía y las ciencias naturales. Veamos algunas razones por las que la linealidad es tan importante:

1. Análisis de Regresión

Uno de los usos más comunes de la linealidad es en el análisis de regresión. El análisis de regresión consiste en encontrar un modelo matemático que mejor se ajuste a un conjunto de datos. Cuando existe una relación lineal entre variables, podemos usar una técnica llamada regresión lineal para encontrar la línea de mejor ajuste.

Si asumimos que existe una relación lineal entre las variables, pero no la hay, podríamos no obtener resultados precisos. Podríamos terminar con un modelo que no describe el comportamiento de las variables que nos interesan, o hacer predicciones significativamente erróneas.

Por ejemplo, supongamos que investigamos cómo la temperatura afecta el crecimiento de las plantas. Asumimos que existe una relación lineal entre temperatura y crecimiento, por lo que usamos regresión lineal para hacer predicciones. Pero si la relación entre temperatura y crecimiento es no lineal (tal vez existe una temperatura óptima donde el crecimiento es máximo, formando una relación curva), entonces nuestro modelo de regresión lineal podría no ser preciso. Podríamos hacer predicciones que no reflejan los resultados del mundo real.

Por eso es importante verificar la linealidad antes de realizar una regresión lineal. Necesitamos confirmar que la relación entre las variables es lineal antes de asumirlo. Si no existe una relación lineal, podríamos necesitar transformar los datos o usar un modelo diferente para capturar el comportamiento de las variables con precisión.

Al verificar la linealidad en la regresión, podemos tener confianza en que nuestros resultados de regresión lineal reflejan correctamente la relación entre las variables que nos interesan.

2. Correlación

Otra razón para interesarnos por la linealidad es que resulta crucial para entender la correlación. La correlación es una medida de cuán fuertemente están relacionadas dos variables. Cuando la relación entre variables es lineal, el coeficiente de correlación (generalmente representado por "r" o "rho") puede darnos información valiosa sobre la fuerza y dirección de la relación.

Un coeficiente de correlación de +1 indica una relación lineal positiva perfecta, mientras que un coeficiente de correlación de -1 señala una relación lineal negativa perfecta. Un coeficiente de correlación de 0 indicaría que no existe relación lineal.

Por ejemplo, supongamos que quieres saber si existe una relación entre las horas que los estudiantes estudian y sus calificaciones en exámenes. Al calcular el coeficiente de correlación, puedes determinar la fuerza y dirección de la relación lineal entre estas dos variables.

3. Análisis de Covarianza (ANCOVA) y Modelos Mixtos

Mientras que el ANOVA estándar no requiere supuestos de linealidad (ya que compara medias entre grupos categóricos), la linealidad se vuelve crítica cuando extendemos el ANOVA a modelos más complejos como ANCOVA (Análisis de Covarianza) o cuando incluimos covariables continuas.

En ANCOVA, examinamos las diferencias entre grupos mientras controlamos por covariables continuas. El supuesto de linealidad establece que la relación entre la covariable y la variable dependiente debe ser lineal en todos los grupos que se comparan.

Por ejemplo, supongamos que comparamos las calificaciones de tres métodos de enseñanza (A, B y C) mientras controlamos por las puntuaciones de conocimiento previo de los estudiantes. Necesitamos asegurar que la relación entre el conocimiento previo y las calificaciones sea lineal para los tres grupos de métodos de enseñanza.

Si la relación entre la covariable y la variable dependiente es no lineal (tal vez curva o mostrando diferentes patrones entre grupos), entonces los resultados de ANCOVA pueden ser sesgados. Las medias ajustadas se estimarían incorrectamente, lo que podría llevar a conclusiones falsas sobre las diferencias entre grupos.

Cuando la linealidad se viola en ANCOVA, tenemos varias opciones: transformar la covariable para lograr linealidad, usar términos polinomiales para modelar relaciones no lineales, o emplear enfoques analíticos alternativos como métodos no paramétricos. Al verificar la linealidad antes de realizar ANCOVA, aseguramos que nuestros resultados reflejen con precisión las diferencias reales entre grupos después de considerar las covariables.

4. Pruebas de Hipótesis

En estadística, las pruebas de hipótesis son un método para determinar si dos variables están relacionadas. Generalmente comenzamos asumiendo que no existe relación entre las variables que examinamos (esto se llama la hipótesis nula). Luego, recopilamos datos y realizamos cálculos para determinar si existe suficiente evidencia para rechazar la hipótesis nula y concluir que existe una relación entre las variables.

Sin embargo, si asumimos que existe una relación lineal entre las variables cuando no la hay, podríamos terminar rechazando la hipótesis nula cuando no deberíamos. Ahí es donde entra la linealidad. Necesitamos verificar que realmente existe una relación lineal entre las variables que estamos probando antes de realizar las pruebas de hipótesis.

Por ejemplo, supongamos que estamos probando si existe una relación entre las horas de ejercicio semanal y los niveles de colesterol. Si existe una relación lineal entre estas variables, podemos usar pruebas de hipótesis para determinar si hay suficiente evidencia para concluir que hacer más ejercicio reduce los niveles de colesterol.

Pero si la relación entre ejercicio y colesterol es no lineal (tal vez curva o mostrando rendimientos decrecientes), entonces nuestras pruebas de hipótesis podrían no ser precisas. Podríamos rechazar la hipótesis nula y concluir que existe una relación entre las variables cuando la relación no sigue el patrón lineal que asumimos.

5. Diseño de Experimentos

En estadística, el diseño experimental nos ayuda a determinar cómo diferentes variables afectan un resultado. Por ejemplo, si investigamos qué factores afectan el crecimiento de las plantas, podríamos manipular variables como la luz, el agua y el fertilizante para observar sus efectos.

En muchos diseños experimentales, asumimos que el efecto de cada variable sobre el resultado es lineal. Ahí es donde entra la linealidad. Necesitamos verificar que la relación entre las variables y el resultado sea lineal antes de diseñar nuestro experimento.

Si asumimos que existe una relación lineal entre una variable y el resultado cuando no la hay, podríamos no obtener los resultados que buscamos. Podríamos manipular la variable y no observar efecto en el resultado, o ver un efecto diferente al esperado.

Por ejemplo, supongamos que investigamos cómo diferentes niveles de luz afectan el crecimiento de las plantas. Asumimos que existe una relación lineal entre luz y crecimiento, así que diseñamos nuestro experimento para probar diferentes niveles de luz. Pero si la relación entre luz y crecimiento es no lineal (tal vez el crecimiento se estabiliza después de cierto umbral), entonces nuestro experimento podría no ser preciso. Podríamos manipular la luz y no observar efecto adicional sobre el crecimiento, o ver un patrón diferente al esperado.

Verificar la linealidad antes de diseñar un experimento es crucial. Necesitamos confirmar que el efecto de cada variable sobre el resultado es lineal antes de asumirlo. Si no existe una relación lineal, podríamos necesitar usar un diseño experimental o modelo diferente para capturar el comportamiento de las variables con precisión.

¿Qué Sucede Cuando se Viola la Linealidad?

Es crucial verificar que tenemos una relación lineal antes de usar un modelo de regresión lineal. Si no lo hacemos, nuestras predicciones serán imprecisas y podríamos no obtener los resultados que buscamos. Violar el supuesto de linealidad podría incluso llevarnos a identificar relaciones donde no existen. Por eso necesitamos verificar la linealidad antes de hacer predicciones.

Si violamos el supuesto de linealidad, podemos obtener resultados seriamente sesgados. Por ejemplo, si intentamos predecir precios de casas basándonos en los metros cuadrados usando regresión lineal múltiple, podríamos asumir que podemos usar un modelo lineal. Pero si la relación entre precios y metros cuadrados no es lineal (tal vez los precios aumentan exponencialmente conforme aumentan los metros cuadrados), entonces nuestro modelo de regresión lineal producirá predicciones imprecisas.

Por eso es esencial siempre verificar la linealidad antes de usar un modelo de regresión lineal. Si no lo hacemos, podríamos terminar con predicciones sesgadas, estimaciones de coeficientes incorrectas, o resultados engañosos en general. Al tomarnos el tiempo de verificar la linealidad, podemos asegurar que nuestros modelos reflejen correctamente las relaciones del mundo real y proporcionen conclusiones válidas sobre los fenómenos que investigamos.

¿Cómo Verificar la Linealidad en Estadística?

Entendiendo que la linealidad es importante, ¿cómo la verificamos realmente? Existen varios métodos que podemos usar:

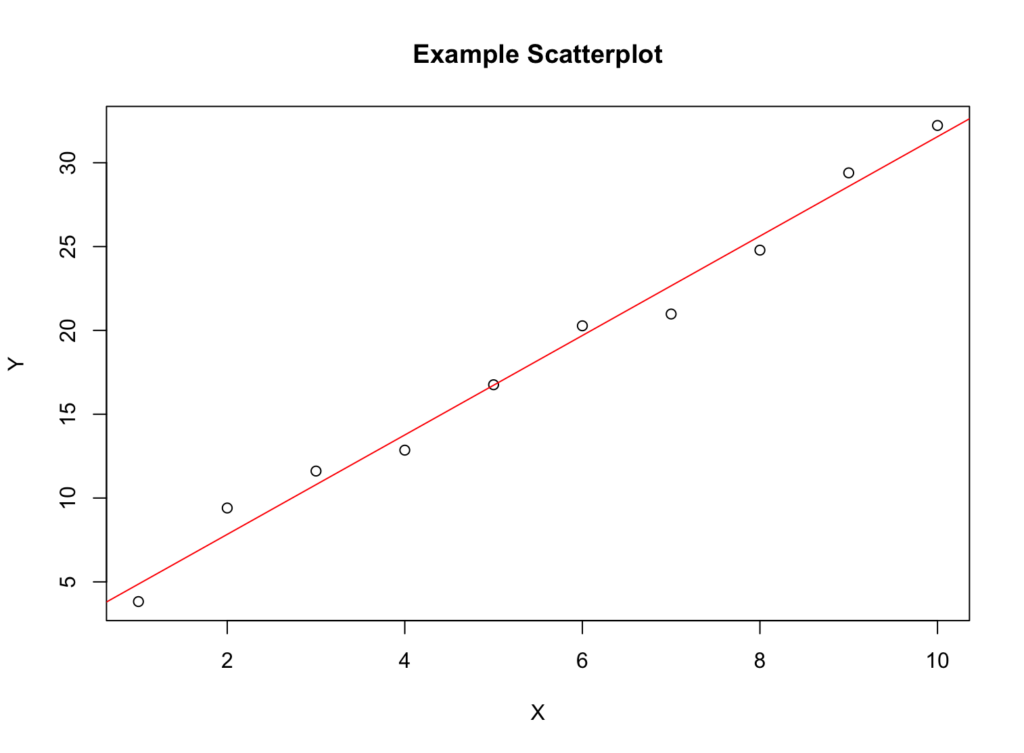

1. Diagramas de Dispersión

Un diagrama de dispersión es un gráfico que muestra la relación entre dos variables. Si existe una relación lineal, los puntos en el diagrama de dispersión formarán un patrón que se aproxima a una línea recta.

Figura 1: Ejemplo de diagrama de dispersión demostrando una relación lineal

2. Coeficiente de Correlación

El coeficiente de correlación mide la fuerza y dirección de la relación lineal entre dos variables. Si existe una relación lineal, el coeficiente de correlación estará cercano a 1 (o -1 para una relación negativa). Por ejemplo, un coeficiente de correlación de 0.9975 indica una relación lineal positiva muy fuerte entre las variables.

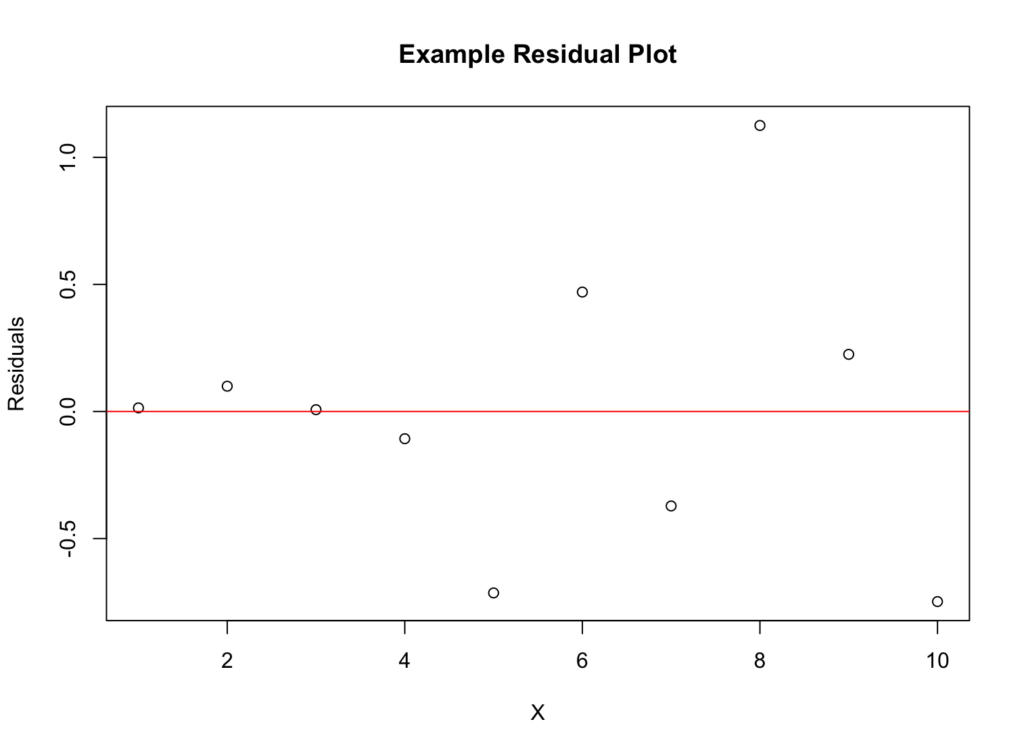

3. Gráficos de Residuos

Un gráfico de residuos muestra la diferencia entre los valores observados y los valores predichos por nuestro modelo de regresión. Si hay una dispersión aleatoria de puntos sin patrón discernible, es probable que el supuesto de linealidad se cumpla. Sin embargo, si hay un patrón (como una curva o forma de embudo), nuestro modelo lineal podría no ser apropiado.

Figura 2: Gráfico de residuos para evaluar la linealidad

Al usar estos métodos diagnósticos, podemos determinar si existe una relación lineal entre dos variables. Si la hay, podemos usar un modelo de regresión lineal para hacer predicciones. Si no la hay, necesitaremos transformar nuestros datos para lograr linealidad o usar un enfoque de modelado diferente (como regresión lineal en Excel con transformaciones polinomiales o modelos no lineales).

Preguntas Frecuentes

Próximos Pasos

En resumen, la linealidad es un concepto fundamental en estadística. Ya sea que realices un análisis de regresión, ANCOVA, o pruebas de hipótesis, necesitas verificar que existe una relación lineal entre las variables que examinas.

Si quieres aplicar estos conocimientos en la práctica, aprende cómo verificar la normalidad en SPSS, otro supuesto clave que debe cumplirse antes de ejecutar modelos lineales. Para profundizar en el análisis de relaciones entre variables, consulta nuestra guía sobre estadísticas descriptivas en SPSS.

Referencias

Cohen, J., Cohen, P., West, S. G., & Aiken, L. S. (2003). Applied Multiple Regression/Correlation Analysis for the Behavioral Sciences (3rd ed.). Routledge.

Field, A. (2013). Discovering Statistics Using IBM SPSS Statistics (4th ed.). Sage.

Kutner, M. H., Nachtsheim, C. J., Neter, J., & Li, W. (2005). Applied Linear Statistical Models (5th ed.). McGraw-Hill.