La verificación de normalidad es uno de los pasos más comunes que los comités de tesis esperan ver antes de cualquier análisis paramétrico. Los t-tests, ANOVA, correlación de Pearson y regresión lineal asumen que los datos (o los residuos) se distribuyen de manera aproximadamente normal. Omitir este paso es una de las críticas más frecuentes en las defensas de tesis.

SPSS ofrece cuatro métodos para verificar la normalidad: la prueba de Shapiro-Wilk, la prueba de Kolmogorov-Smirnov, los gráficos Q-Q y los histogramas con curvas normales. Esta guía cubre los cuatro, explica cómo interpretar el output y muestra qué hacer cuando tus datos no cumplen el supuesto de normalidad.

Puntos clave:

- Usa el procedimiento Explorar (Analyze > Descriptive Statistics > Explore) para ejecutar todas las verificaciones de normalidad en un solo paso: Shapiro-Wilk, K-S, histogramas y gráficos Q-Q

- La prueba de Shapiro-Wilk es más potente que la de Kolmogorov-Smirnov y se prefiere para la mayoría del trabajo de tesis (muestras hasta 2,000)

- Una prueba significativa (p < .05) significa que los datos se desvían de la normalidad, pero la severidad práctica importa más que el valor p, especialmente en muestras grandes

- Asimetría entre -1 y +1 generalmente indica normalidad aceptable para pruebas paramétricas; valores más allá de +/-2 indican un problema serio

- Cuando la normalidad falla, tienes tres opciones: alternativas no paramétricas, transformaciones de datos o proceder con justificación (pruebas paramétricas robustas)

Antes de comenzar: Esta guía asume que tienes tus datos cargados en SPSS con las variables correctamente definidas en la Vista de Variables. Si aún no has ejecutado estadísticas descriptivas, comienza con nuestra guía de estadísticas descriptivas en SPSS. También deberías verificar que tus variables continuas tengan el nivel de medición configurado como Escala en la Vista de Variables.

Por Qué la Normalidad Importa para Tu Tesis

Las pruebas estadísticas paramétricas (t-tests, ANOVA, correlación de Pearson, regresión lineal) se basan en el supuesto de que los datos siguen una distribución aproximadamente en forma de campana y simétrica. Cuando este supuesto se viola severamente, los valores p producidos por estas pruebas pueden ser imprecisos, lo que lleva a conclusiones incorrectas sobre tus hipótesis.

La pregunta práctica para el trabajo de tesis no es si tus datos son perfectamente normales. Ningún conjunto de datos real lo es. La pregunta es si la desviación de la normalidad es lo suficientemente severa como para comprometer tu análisis. Esta distinción importa porque:

Las pruebas paramétricas son robustas ante violaciones moderadas. La investigación muestra consistentemente que los t-tests y ANOVA funcionan bien incluso cuando el supuesto de normalidad se viola modestamente, particularmente con tamaños de muestra superiores a 30 (Glass, Peckham y Sanders, 1972; Schmider et al., 2010). Una distribución ligeramente asimétrica no invalidará tus resultados.

Con muestras grandes, las pruebas formales se vuelven excesivamente sensibles. La prueba de Shapiro-Wilk marcará una desviación trivial de la normalidad como "significativa" cuando tienes 300 o más casos, aunque la desviación no tenga impacto práctico alguno en los resultados de tus pruebas paramétricas.

Con muestras pequeñas, las pruebas formales carecen de poder. Cuando tienes menos de 20 casos, tanto la prueba de Shapiro-Wilk como la de K-S pueden no detectar distribuciones genuinamente no normales. Los métodos visuales se vuelven esenciales.

Por eso los investigadores experimentados usan múltiples métodos en conjunto en lugar de depender de una sola prueba o un solo umbral.

Qué Método de Normalidad Usar

SPSS ofrece varios enfoques para evaluar la normalidad. Cada uno tiene fortalezas y limitaciones, y tu tesis es más sólida cuando combinas al menos dos.

| Método | Tipo | Fortalezas | Limitaciones | Ideal Para |

|---|---|---|---|---|

| Shapiro-Wilk | Prueba estadística | Prueba formal más potente; ampliamente recomendada | Excesivamente sensible en muestras grandes (n > 300); limitada a n < 2,000 | Prueba formal principal para la mayoría del trabajo de tesis |

| Kolmogorov-Smirnov (Lilliefors) | Prueba estadística | Sin límite superior de tamaño de muestra | Bajo poder en muestras pequeñas; menos sensible que Shapiro-Wilk | Prueba secundaria; requerida por algunos comités |

| Gráfico Q-Q | Visual | Muestra exactamente dónde y cómo se desvía la distribución; no se ve afectado por el tamaño de muestra | Requiere interpretación subjetiva | Complemento esencial a las pruebas formales |

| Histograma | Visual | Intuitivo; revela la forma de la distribución, brechas y agrupaciones | Difícil de juzgar con muestras pequeñas; el ancho de los intervalos afecta la apariencia | Revisión inicial rápida |

| Asimetría/Curtosis | Numérico | Umbrales simples; fácil de reportar | Sin prueba de hipótesis formal; los umbrales son convenciones, no reglas | Evidencia complementaria para reportes APA |

Tabla 1: Comparación de los métodos de evaluación de normalidad en SPSS

Enfoque recomendado para el trabajo de tesis: Ejecuta la prueba de Shapiro-Wilk como tu prueba formal principal, inspecciona el gráfico Q-Q para confirmación visual y reporta los valores de asimetría/curtosis como evidencia complementaria. Incluye histogramas en tu apéndice si tu comité desea ver las formas de distribución.

Conjunto de Datos de Ejemplo

Este tutorial usa el mismo conjunto de datos de tesis de nuestra guía de estadísticas descriptivas. Puedes descargarlo desde la barra lateral. El conjunto de datos incluye 150 encuestados con variables diseñadas específicamente para demostrar distribuciones tanto normales como no normales:

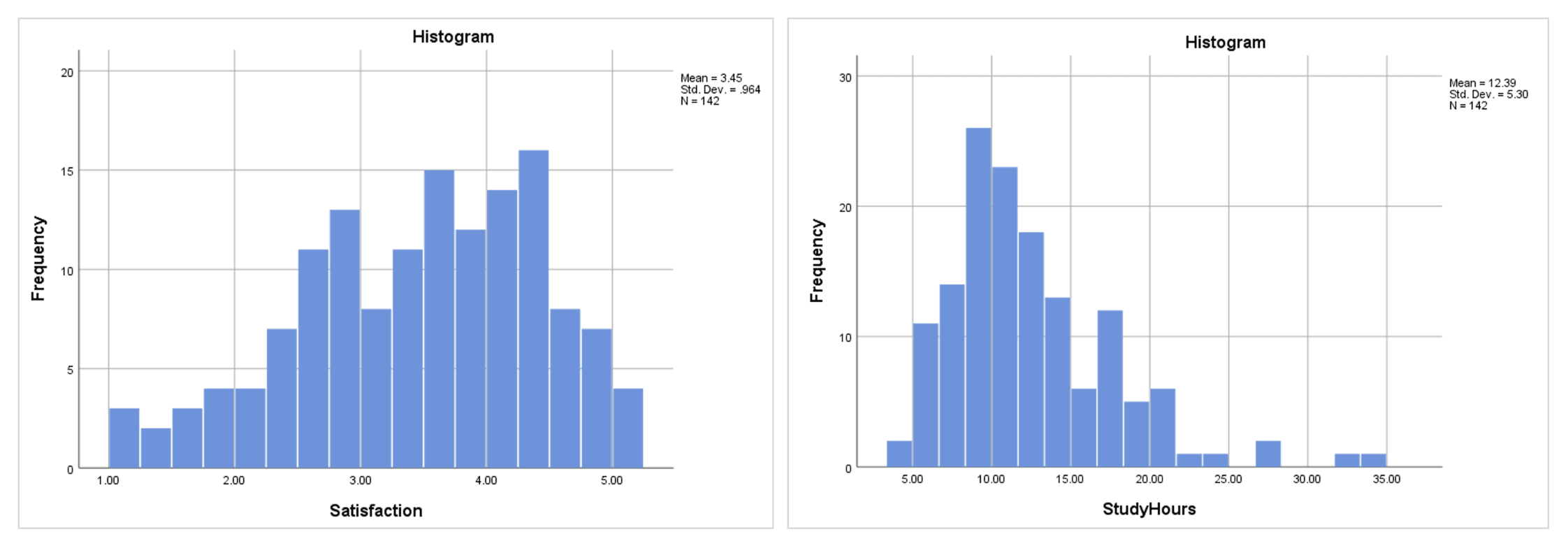

- Satisfaction (Escala, 1.00 a 5.00): aproximadamente distribuida normalmente según asimetría y curtosis, aunque la prueba de Shapiro-Wilk la marca como significativa debido a la sensibilidad del tamaño de muestra.

- StudyHours (Escala, 3.40 a 35.00): asimetría positiva con dos valores atípicos leves. Esta variable tiene violaciones genuinas de normalidad visibles tanto en las estadísticas de prueba como en el output visual.

- GPA (Escala, 1.80 a 4.00): aproximadamente distribuida normalmente.

- Age (Escala, 18 a 40): aproximadamente distribuida normalmente.

Trabajar con variables tanto normales como no normales en el mismo análisis es intencional. También crea el escenario exacto que la mayoría de los estudiantes de tesis encuentran: un resultado de Shapiro-Wilk significativo que no necesariamente significa que los datos son inutilizables para pruebas paramétricas.

Paso a Paso: Ejecutar Pruebas de Normalidad en SPSS

El procedimiento Explorar es la forma más eficiente de verificar la normalidad porque produce los cuatro métodos (Shapiro-Wilk, K-S, gráficos Q-Q e histogramas) en una sola ejecución.

Paso 1: Abrir el Cuadro de Diálogo Explorar

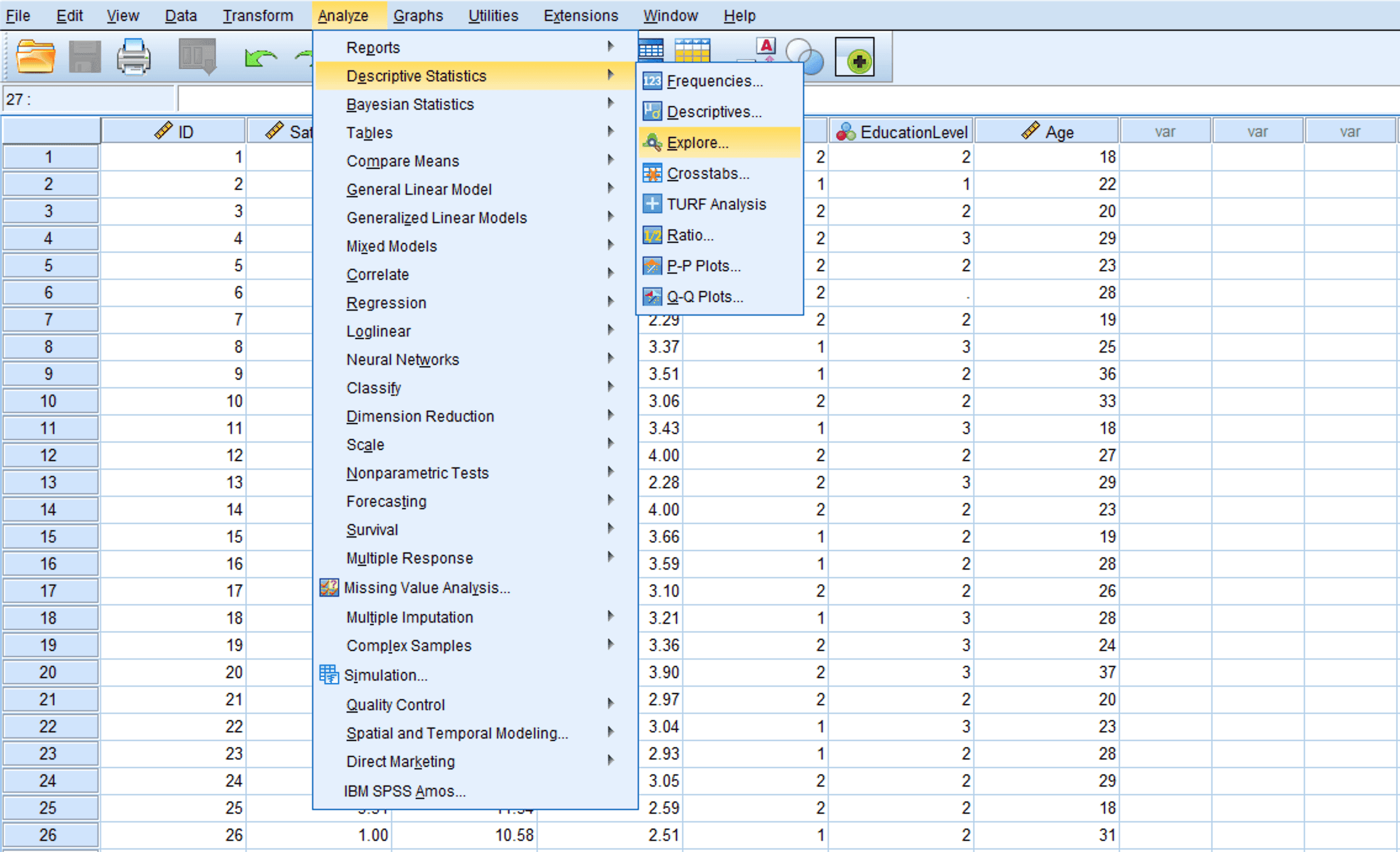

Ve a Analyze > Descriptive Statistics > Explore.

Figura 1: Navega a Analyze > Descriptive Statistics > Explore en el menú de SPSS

Paso 2: Seleccionar Tus Variables

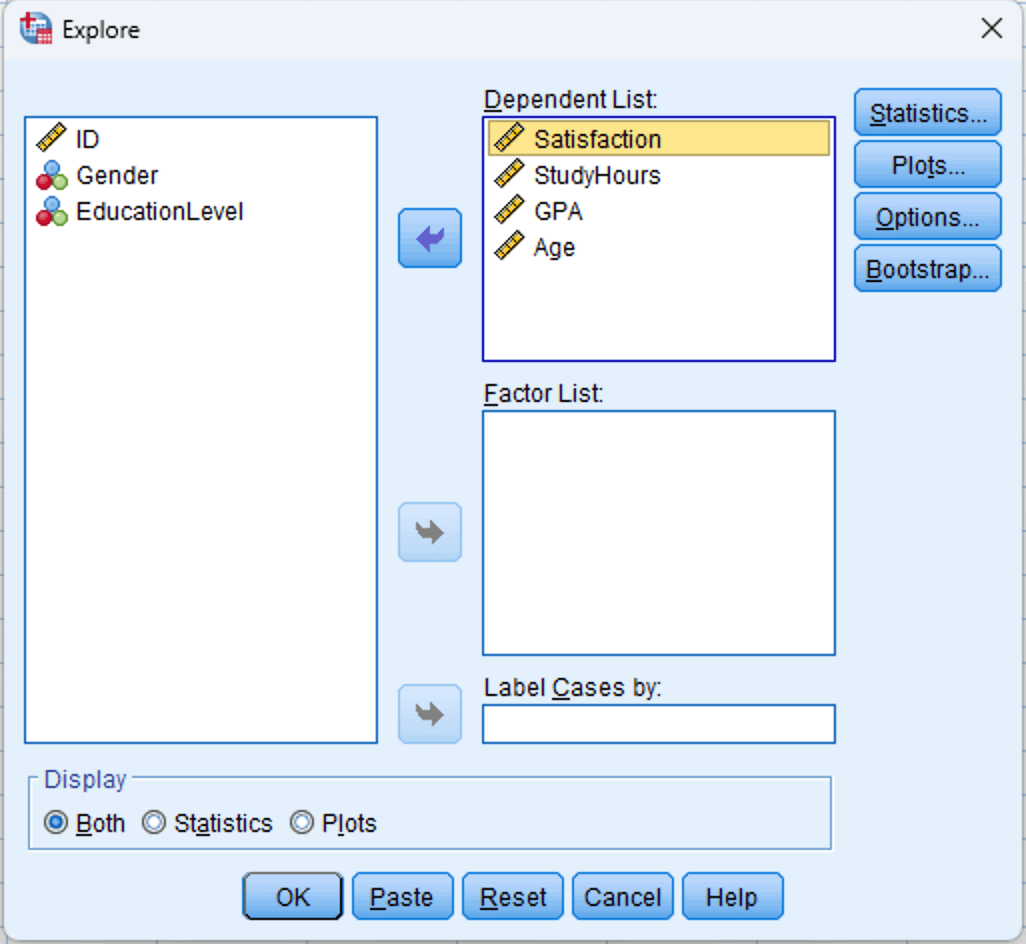

Mueve las variables continuas que deseas evaluar al cuadro Dependent List (Lista de dependientes). Para este tutorial, mueve Satisfaction, StudyHours, GPA y Age a la Lista de dependientes.

No incluyas variables categóricas (Gender, EducationLevel) en la Lista de dependientes. Las pruebas de normalidad aplican solo a variables continuas.

Si necesitas evaluar la normalidad dentro de grupos (por ejemplo, puntuaciones de Satisfaction para hombres y mujeres por separado), agrega la variable de agrupación al cuadro Factor List (Lista de factores). Esto es importante cuando tu análisis posterior compara grupos, porque el supuesto de normalidad aplica dentro de cada grupo.

Figura 2: Cuadro de diálogo Explorar con Satisfaction, StudyHours, GPA y Age en la Lista de dependientes

Paso 3: Habilitar los Gráficos de Normalidad

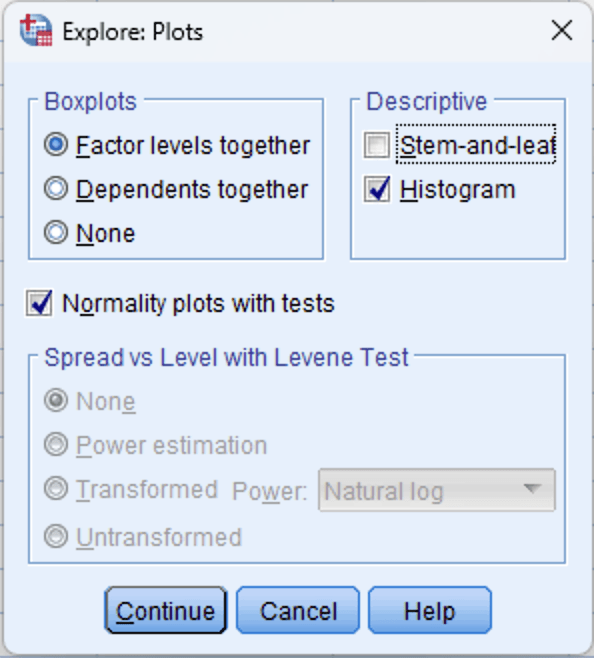

Haz clic en el botón Plots (Gráficos) en el cuadro de diálogo Explorar. En el sub-cuadro de diálogo Plots:

- Marca Normality plots with tests (Gráficos de normalidad con pruebas). Esto habilita las pruebas de Shapiro-Wilk y Kolmogorov-Smirnov junto con los gráficos Q-Q.

- En Boxplots, mantén seleccionado Factor levels together (Niveles de factor juntos, la opción predeterminada).

- Opcionalmente marca Histogram si deseas que los histogramas se incluyan en el output.

Haz clic en Continue para regresar al cuadro de diálogo principal.

Figura 3: Cuadro de diálogo Plots de Explorar: marca "Normality plots with tests" y opcionalmente "Histogram"

Paso 4: Ejecutar el Análisis

Haz clic en OK en el cuadro de diálogo principal de Explorar. SPSS producirá el output en el Visor de resultados, incluyendo:

- Una tabla de Descriptivos (con valores de asimetría y curtosis)

- La tabla de Pruebas de normalidad (Shapiro-Wilk y Kolmogorov-Smirnov)

- Gráficos Q-Q normales para cada variable

- Gráficos Q-Q normales sin tendencia

- Histogramas (si se seleccionaron)

- Diagramas de caja

Interpretación del Output

La Tabla de Pruebas de Normalidad

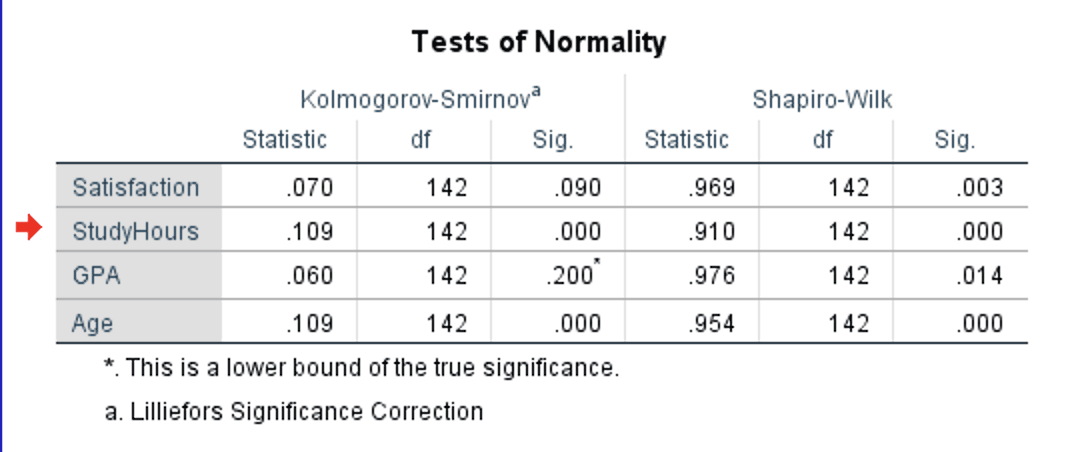

Esta es típicamente la primera tabla que tu comité revisará. SPSS produce tanto los resultados de Kolmogorov-Smirnov (con corrección de Lilliefors) como de Shapiro-Wilk en paralelo.

Figura 4: Tabla de Pruebas de Normalidad con resultados de Kolmogorov-Smirnov y Shapiro-Wilk para las cuatro variables

Cómo leer esta tabla:

- Statistic (Estadístico): El valor del estadístico de prueba. Para Shapiro-Wilk, valores más cercanos a 1.000 indican normalidad más fuerte. Para K-S, valores más pequeños indican mejor ajuste a una distribución normal.

- df (Grados de libertad): Iguales a tu tamaño de muestra para cada variable, menos los casos perdidos.

- Sig.: El valor p. Este es el número que determina tu conclusión.

Regla de decisión:

- Si Sig. > .05: Los datos no se desvían significativamente de la normalidad. Puedes proceder con pruebas paramétricas.

- Si Sig. < .05: Los datos se desvían significativamente de la normalidad. Se necesita investigación adicional (verifica la severidad usando asimetría/curtosis y gráficos Q-Q).

En el output de ejemplo, observa que las cuatro variables tienen resultados de Shapiro-Wilk significativos (p < .05). Este es un escenario común con muestras de 100 o más casos, e ilustra por qué nunca deberías depender del valor p solo.

La distinción crítica es entre desviaciones estadísticamente significativas y prácticamente importantes. StudyHours (W = .910, p < .001) es genuinamente no normal con una asimetría de 1.39 y curtosis de 3.05. Pero Satisfaction (W = .969, p = .003), GPA (W = .976, p = .014) y Age (W = .954, p < .001) tienen valores de asimetría y curtosis bien dentro del rango de -1 a +1. La prueba de Shapiro-Wilk detectó desviaciones triviales en estas tres variables que no tienen impacto práctico en los resultados de las pruebas paramétricas. Los gráficos Q-Q y los valores de asimetría/curtosis (cubiertos abajo) lo confirman.

También observa que la prueba de K-S cuenta una historia diferente: Satisfaction (p = .090) y GPA (p = .200) no son significativos, mientras que StudyHours (p < .001) y Age (p < .001) son significativos. Esto demuestra la diferencia de poder entre las dos pruebas. K-S no detectó las desviaciones menores que Shapiro-Wilk sí detectó.

¿Qué prueba reportar? Usa el resultado de Shapiro-Wilk como tu prueba principal. Es más potente (mejor para detectar falta de normalidad) y es recomendada por la mayoría de los libros de texto de estadística (Field, 2018; Pallant, 2020). Reporta el resultado de K-S junto con él si tu comité o revista lo requiere. Pero siempre complementa la prueba formal con valores de asimetría/curtosis y gráficos Q-Q, como demuestra este ejemplo.

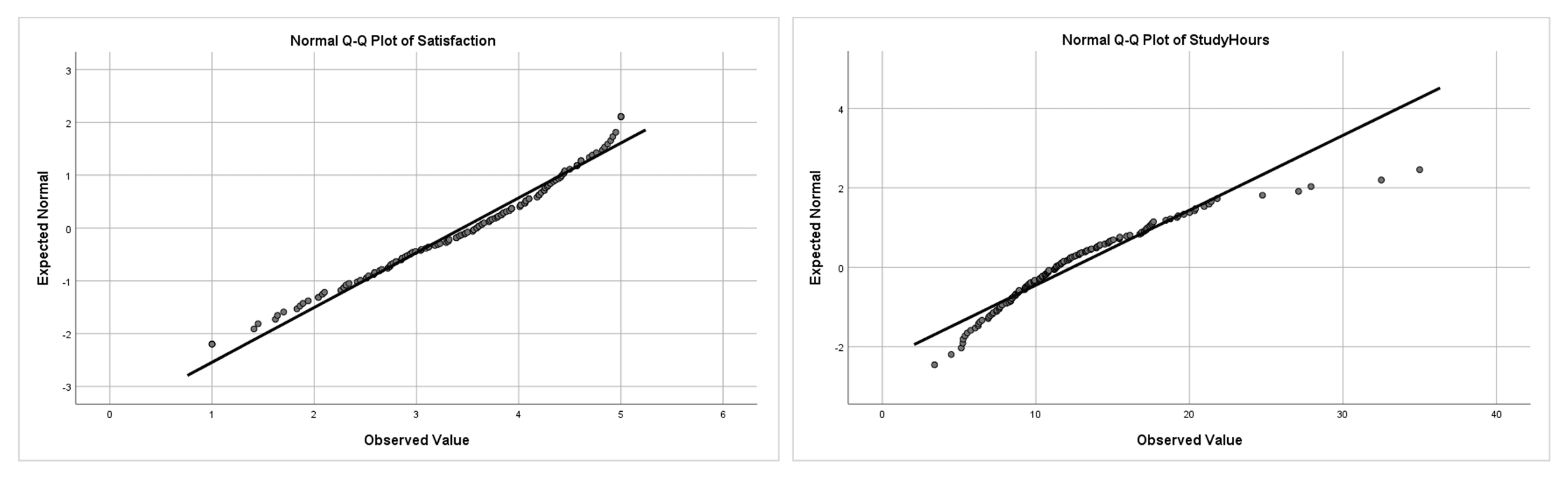

El Gráfico Q-Q

El gráfico Q-Q Normal (gráfico cuantil-cuantil) grafica los valores esperados de una distribución normal en el eje X contra los valores observados de tus datos en el eje Y. Si los datos son perfectamente normales, todos los puntos caen sobre la línea diagonal.

Figura 5: Gráficos Q-Q lado a lado: Satisfaction (izquierda) sigue la diagonal de cerca, indicando normalidad aproximada; StudyHours (derecha) se curva alejándose en el extremo superior, indicando asimetría positiva

Cómo interpretar gráficos Q-Q:

- Puntos sobre o cerca de la línea: Los datos son aproximadamente normales. Una dispersión menor alrededor de la línea es esperada y aceptable.

- Curva sistemática (forma de S o de plátano): Los datos son asimétricos. Una curva ascendente en el extremo derecho indica asimetría positiva (como con StudyHours). Una curva descendente en el extremo izquierdo indica asimetría negativa.

- Puntos que se alejan en ambos extremos: Colas pesadas (distribución leptocúrtica). Los puntos caen por debajo de la línea a la izquierda y por encima a la derecha.

- Puntos individuales lejos de la línea: Posibles valores atípicos. Si solo uno o dos puntos en los extremos se desvían sustancialmente, probablemente son valores atípicos en lugar de evidencia de falta de normalidad en la distribución general.

Los gráficos Q-Q son particularmente valiosos para muestras grandes donde la prueba de Shapiro-Wilk puede ser excesivamente sensible. Un gráfico Q-Q que se ve razonablemente recto es evidencia sólida de que tus datos son aceptables para pruebas paramétricas, incluso si la prueba formal produce un valor p significativo.

Histogramas con Curva Normal

Los histogramas proporcionan una vista intuitiva de la forma de tu distribución. SPSS superpone una curva normal en el histograma cuando lo solicitas a través del procedimiento Explorar.

Figura 6: Histogramas lado a lado: Satisfaction (izquierda) muestra una distribución aproximadamente simétrica; StudyHours (derecha) tiene asimetría positiva visible con una cola larga

Los histogramas son mejores para una revisión inicial que para una evaluación formal. Se ven afectados por el ancho del intervalo (el número de barras), y con muestras pequeñas la forma puede verse irregular incluso cuando la distribución subyacente es normal. Úsalos junto con gráficos Q-Q y pruebas formales, no como tu único método.

Valores de Asimetría y Curtosis

El procedimiento Explorar incluye la asimetría y curtosis en la tabla de Descriptivos (la misma tabla que contiene medias y desviaciones estándar). Si ya ejecutaste estadísticas descriptivas en estas variables, tienes estos valores del output anterior.

| Variable | Asimetría (EE) | Curtosis (EE) | Interpretación |

|---|---|---|---|

| Satisfaction | -0.477 (0.203) | -0.409 (0.404) | Dentro de +/-1: aproximadamente normal |

| StudyHours | 1.392 (0.203) | 3.053 (0.404) | Asimetría > 1: asimetría positiva; curtosis > 2: colas pesadas |

| GPA | -0.161 (0.203) | -0.718 (0.404) | Dentro de +/-1: aproximadamente normal |

| Age | 0.415 (0.203) | -0.500 (0.404) | Dentro de +/-1: aproximadamente normal |

Tabla 2: Valores de asimetría y curtosis del output descriptivo de Explorar

Umbrales de interpretación:

| Rango | Interpretación de Asimetría | Interpretación de Curtosis | Acción |

|---|---|---|---|

| -1 a +1 | Aproximadamente simétrica | Colas aproximadamente normales | Seguro para pruebas paramétricas |

| -2 a -1 o +1 a +2 | Moderadamente asimétrica | Colas moderadamente no normales | Generalmente aceptable, especialmente con n > 30 |

| Más allá de +/-2 | Sustancialmente asimétrica | Colas sustancialmente no normales | Considera pruebas no paramétricas o transformaciones |

Tabla 3: Umbrales de interpretación de asimetría y curtosis para la evaluación de normalidad

Ten en cuenta que estos umbrales son convenciones, no reglas absolutas. Diferentes fuentes recomiendan diferentes puntos de corte. George y Mallery (2019) usan +/-1 para "excelente" y +/-2 para "aceptable." Hair et al. (2019) consideran valores más allá de +/-1.96 como significativos al nivel .05 para muestras mayores a 50. El punto clave es declarar qué umbral aplicaste en tu tesis y aplicarlo de manera consistente en todas las variables.

Qué Hacer Cuando la Normalidad Falla

Cuando una o más variables no pasan las pruebas de normalidad, tienes tres opciones. La mejor elección depende de qué tan severamente se desvía la distribución y qué análisis planeas ejecutar.

Opción 1: Usar Alternativas No Paramétricas

Las pruebas no paramétricas no asumen normalidad y son la solución más directa cuando la violación es severa.

| Prueba Paramétrica | Alternativa No Paramétrica | Cuándo Cambiar |

|---|---|---|

| t-test de muestras independientes | Prueba U de Mann-Whitney | Asimetría severa o muestra pequeña con datos no normales |

| t-test de muestras pareadas | Prueba de rangos con signo de Wilcoxon | Asimetría severa en las puntuaciones de diferencia |

| ANOVA de un factor | Prueba H de Kruskal-Wallis | Asimetría severa en uno o más grupos |

| Correlación de Pearson | Correlación de rangos de Spearman | Relación no lineal o datos ordinales |

Tabla 4: Pruebas paramétricas y sus alternativas no paramétricas

Opción 2: Transformar los Datos

Las transformaciones de datos pueden reducir la asimetría y acercar una variable a una distribución normal. Transformaciones comunes en SPSS:

Para datos con asimetría positiva:

- Transformación logarítmica: Transform > Compute Variable >

LN(variable). Mejor para asimetría positiva moderada. - Transformación de raíz cuadrada: Transform > Compute Variable >

SQRT(variable). Corrección más suave que la logarítmica.

Para datos con asimetría negativa:

- Reflejar y aplicar logaritmo: Transform > Compute Variable >

LN(K - variable)donde K es uno más que el valor máximo.

Después de transformar, vuelve a ejecutar las pruebas de normalidad en la variable transformada. Si pasa, usa la variable transformada en tu análisis. Reporta tanto las estadísticas descriptivas originales (para interpretabilidad) como una nota de que la variable transformada se usó en las pruebas inferenciales.

La desventaja de las transformaciones es que la interpretación se vuelve menos intuitiva. Una puntuación de satisfacción transformada logarítmicamente no tiene el mismo significado directo que la escala original.

Opción 3: Proceder con Pruebas Paramétricas (con Justificación)

Si la violación de normalidad es de leve a moderada, a menudo puedes proceder con pruebas paramétricas y proporcionar justificación. Este enfoque está respaldado por investigación que muestra que los t-tests y ANOVA son robustos ante falta de normalidad con muestras superiores a 30 (Schmider et al., 2010).

Tu justificación en la tesis debería incluir:

- Los valores específicos de asimetría/curtosis (demostrando que la violación es moderada)

- El tamaño de muestra (muestras más grandes hacen que las pruebas paramétricas sean más robustas)

- Una cita respaldando la afirmación de robustez (por ejemplo, Field, 2018; Glass et al., 1972)

- Evidencia visual (gráfico Q-Q mostrando que la desviación es menor)

Este es frecuentemente el enfoque más práctico para el trabajo de tesis. En nuestro ejemplo, Satisfaction tiene una asimetría de -0.48 y la prueba de Shapiro-Wilk fue significativa (p = .003), pero la asimetría está bien dentro del rango de -1 a +1, y el gráfico Q-Q confirma normalidad aproximada. Incluso StudyHours con una asimetría de 1.39 no invalida necesariamente un t-test con 142 casos, aunque la curtosis de 3.05 justifica más precaución. Si tu variable es una escala compuesta (como Satisfaction), verifica también su fiabilidad con el Alfa de Cronbach en SPSS antes de proceder a las pruebas inferenciales.

Reporte de Normalidad en Formato APA

Reporte en el Texto

Cuando la prueba de Shapiro-Wilk es significativa pero la asimetría/curtosis son aceptables:

Se evaluó la normalidad mediante la prueba de Shapiro-Wilk, la inspección visual de gráficos Q-Q y los valores de asimetría/curtosis. Aunque la prueba de Shapiro-Wilk fue significativa para Satisfaction, W(142) = .969, p = .003, la asimetría (-0.48, EE = 0.20) y la curtosis (-0.41, EE = 0.40) se encontraron dentro del rango de -1 a +1, y el gráfico Q-Q no mostró desviación sistemática de la diagonal. Dada la sensibilidad de la prueba de Shapiro-Wilk con muestras superiores a 100 y la robustez de las pruebas paramétricas ante violaciones menores de normalidad (Schmider et al., 2010), se mantuvo el análisis paramétrico.

Cuando se reportan múltiples variables con asimetría/curtosis aceptables:

Las pruebas de Shapiro-Wilk fueron significativas para Satisfaction (W = .969, p = .003), GPA (W = .976, p = .014) y Age (W = .954, p < .001). Sin embargo, los valores de asimetría y curtosis para las tres variables se encontraron dentro del rango aceptable de -1 a +1 (ver Tabla X), y los gráficos Q-Q indicaron normalidad aproximada. Estos resultados son consistentes con la sensibilidad conocida de la prueba de Shapiro-Wilk en muestras que exceden los 100 casos (Field, 2018).

Cuando la normalidad se viola genuinamente:

La prueba de Shapiro-Wilk indicó que StudyHours no se distribuyó normalmente, W(142) = .910, p < .001, con una asimetría de 1.39 (EE = 0.20) y curtosis de 3.05 (EE = 0.40). La inspección visual del gráfico Q-Q confirmó la asimetría positiva, con puntos de datos curvándose alejándose de la diagonal en el extremo superior. En consecuencia, se utilizó la prueba U de Mann-Whitney en lugar del t-test de muestras independientes para las comparaciones de grupo que involucraban esta variable.

Cuando se procede a pesar de una violación moderada:

Aunque la prueba de Shapiro-Wilk fue significativa para StudyHours, W(142) = .910, p < .001, la asimetría (1.39) se encontró dentro del rango de -2 a +2 que Hair et al. (2019) consideran aceptable. Dado el tamaño de muestra (N = 142) y la robustez conocida del t-test de muestras independientes ante violaciones moderadas de normalidad (Schmider et al., 2010), se mantuvo el análisis paramétrico.

Tabla Resumen de Normalidad en Formato APA

| Variable | W | p | Asimetría (EE) | Curtosis (EE) | Decisión |

|---|---|---|---|---|---|

| Satisfaction | .969 | .003 | -0.48 (0.20) | -0.41 (0.40) | Aceptable (asimetría/curtosis dentro de +/-1) |

| StudyHours | .910 | < .001 | 1.39 (0.20) | 3.05 (0.40) | No normal (asimetría > 1, curtosis > 2) |

| GPA | .976 | .014 | -0.16 (0.20) | -0.72 (0.40) | Aceptable (asimetría/curtosis dentro de +/-1) |

| Age | .954 | < .001 | 0.42 (0.20) | -0.50 (0.40) | Aceptable (asimetría/curtosis dentro de +/-1) |

Tabla 5: Resumen de resultados de evaluación de normalidad del procedimiento Explorar

Esta tabla demuestra un escenario real común: todas las pruebas de Shapiro-Wilk son significativas, pero solo StudyHours tiene valores de asimetría y curtosis que indican un problema genuino. Para las otras tres variables, la columna "Decisión" refleja la evaluación práctica basada en los umbrales de asimetría/curtosis y la inspección del gráfico Q-Q, no solo el valor p de Shapiro-Wilk.

Errores Comunes al Verificar la Normalidad en SPSS

1. Depender Únicamente del Valor p de Shapiro-Wilk

Como demuestra el ejemplo en esta guía, las cuatro variables produjeron resultados de Shapiro-Wilk significativos, pero solo StudyHours tenía un problema genuino de normalidad. Siempre complementa la prueba formal con gráficos Q-Q y valores de asimetría/curtosis.

2. Evaluar lo Incorrecto

Para regresión múltiple, el supuesto de normalidad aplica a los residuos, no a las variables originales. Para t-tests y ANOVA, aplica dentro de cada grupo. Ejecutar una prueba de normalidad global en toda la muestra de una variable sin considerar el contexto del análisis puede llevar a conclusiones incorrectas. Evalúa la normalidad al nivel que corresponda con tu análisis planificado.

3. Usar Kolmogorov-Smirnov como Prueba Principal

Muchos libros de texto antiguos y tutoriales en línea recomiendan la prueba de K-S como la predeterminada. La prueba de Kolmogorov-Smirnov tiene sustancialmente menor poder estadístico que la prueba de Shapiro-Wilk, lo que significa que es más probable que no detecte falta de normalidad genuina (un error Tipo II). Usa Shapiro-Wilk como tu prueba principal a menos que tu comité requiera específicamente K-S.

4. Ignorar la Evidencia Visual

Algunos estudiantes reportan "la prueba de Shapiro-Wilk no fue significativa, por lo tanto se asume normalidad" sin mirar la distribución real. Una prueba no significativa con una muestra pequeña podría simplemente significar que la prueba careció de poder. Siempre inspecciona el gráfico Q-Q y el histograma. Si los métodos visuales revelan problemas claros (curvatura fuerte, bimodalidad, valores atípicos extremos), investiga más independientemente del valor p.

5. Aplicar un Umbral Único para Todo

Usar +/-2 para asimetría como un punto de corte absoluto sin considerar el tamaño de muestra o el análisis específico es demasiado rígido. Con una muestra de 15, incluso una asimetría de 1.5 podría ser problemática. Con una muestra de 500, una asimetría de 1.5 puede tener un impacto insignificante en los resultados de tu t-test. Reporta los valores y justifica tu decisión basándote en el contexto específico.

6. Olvidar Evaluar la Normalidad por Grupo

Cuando comparas grupos (t-test independiente, ANOVA de un factor), el supuesto de normalidad aplica dentro de cada grupo. Evaluar la distribución general de la variable (ignorando los grupos) puede producir resultados engañosos. Dos grupos no normales pueden combinarse en lo que parece ser una distribución normal, y viceversa. Usa la Lista de factores en el procedimiento Explorar para evaluar cada grupo por separado.

7. Transformar los Datos sin Volver a Verificar

Después de aplicar una transformación logarítmica o de raíz cuadrada, algunos estudiantes proceden a su análisis sin verificar que la transformación realmente funcionó. Siempre vuelve a ejecutar las pruebas de normalidad en la variable transformada. Si la transformación no logra normalidad aproximada, una prueba no paramétrica puede ser más apropiada que apilar múltiples transformaciones.

Lo Que Tu Comité de Tesis Preguntará

"¿Cómo evaluaste la normalidad?" La respuesta más sólida demuestra múltiples métodos: "Evalué la normalidad usando la prueba de Shapiro-Wilk, la inspección visual de gráficos Q-Q y los valores de asimetría/curtosis. La prueba de Shapiro-Wilk no fue significativa para todas las variables, los gráficos Q-Q no mostraron desviación sistemática de la diagonal, y los valores de asimetría y curtosis se encontraron dentro del rango de -1 a +1." Esto demuestra rigor en lugar de depender de un solo indicador.

"¿Por qué usaste la prueba de Shapiro-Wilk en lugar de la de Kolmogorov-Smirnov?" Explica que la prueba de Shapiro-Wilk tiene mayor poder estadístico, lo que significa que es mejor para detectar falta de normalidad. Es recomendada por Field (2018) y Razali y Wah (2011) como la prueba preferida para muestras hasta 2,000. SPSS produce ambas pruebas simultáneamente, por lo que puedes reportar K-S junto con Shapiro-Wilk si el comité lo prefiere.

"Tu prueba de Shapiro-Wilk fue significativa. ¿Por qué usaste una prueba paramétrica?" Esta pregunta surge frecuentemente. Cita los valores específicos de asimetría y curtosis, referencia la literatura de robustez (Schmider et al., 2010), señala el gráfico Q-Q y menciona tu tamaño de muestra. Una respuesta bien preparada aborda tanto la evidencia estadística como la justificación metodológica.

"¿Qué habrías hecho diferente si la normalidad se hubiera violado severamente?" Demuestra que consideraste alternativas: "Si la asimetría hubiera excedido +/-2 o el gráfico Q-Q hubiera mostrado curvatura sistemática, habría considerado transformación de datos (logarítmica o raíz cuadrada) y vuelto a evaluar la normalidad. Si la transformación no hubiera sido exitosa, habría usado el equivalente no paramétrico, como la prueba U de Mann-Whitney en lugar del t-test de muestras independientes."

"¿Necesitas evaluar la normalidad para cada grupo por separado?" Para análisis que comparan grupos (t-tests, ANOVA), la respuesta es sí. Explica que usaste la Lista de factores en el procedimiento Explorar para producir pruebas de normalidad separadas por grupo. Esto demuestra conciencia de que el supuesto de normalidad aplica dentro de los grupos, no globalmente.

Preguntas Frecuentes

Próximos Pasos

Con la normalidad evaluada, tu siguiente paso depende de lo que encontraste.

Si necesitas comparar medias entre dos grupos, aprende cómo ejecutar un t-test de muestras independientes en SPSS, que incluye la verificación de normalidad por grupo y las alternativas no paramétricas cuando la normalidad falla. Si tus datos son mediciones repetidas del mismo grupo, consulta en cambio el t-test de muestras pareadas en SPSS.

Referencias

American Psychological Association. (2020). Publication manual of the American Psychological Association (7th ed.). American Psychological Association.

Field, A. (2018). Discovering statistics using IBM SPSS statistics (5th ed.). SAGE Publications.

George, D., & Mallery, P. (2019). IBM SPSS statistics 26 step by step: A simple guide and reference (16th ed.). Routledge.

Glass, G. V., Peckham, P. D., & Sanders, J. R. (1972). Consequences of failure to meet assumptions underlying the fixed effects analyses of variance and covariance. Review of Educational Research, 42(3), 237-288.

Hair, J. F., Babin, B. J., Anderson, R. E., & Black, W. C. (2019). Multivariate data analysis (8th ed.). Cengage Learning.

Pallant, J. (2020). SPSS survival manual (7th ed.). Open University Press.

Razali, N. M., & Wah, Y. B. (2011). Power comparisons of Shapiro-Wilk, Kolmogorov-Smirnov, Lilliefors and Anderson-Darling tests. Journal of Statistical Modeling and Analytics, 2(1), 21-33.

Schmider, E., Ziegler, M., Danay, E., Beyer, L., & Bühner, M. (2010). Is it really robust? Reinvestigating the robustness of ANOVA against violations of the normal distribution assumption. Methodology, 6(4), 147-151.

Tabachnick, B. G., & Fidell, L. S. (2019). Using multivariate statistics (7th ed.). Pearson.