La prueba t de muestras independientes es una de las pruebas estadísticas más utilizadas en la investigación de tesis. Responde una pregunta directa: ¿difieren dos grupos en un resultado continuo? Ya sea que compares puntuaciones de satisfacción entre hombres y mujeres, calificaciones de examen entre un grupo de tratamiento y uno de control, o métricas de rendimiento entre dos departamentos, la prueba t de muestras independientes es el enfoque estándar.

Esta guía cubre el flujo de trabajo completo en SPSS: verificación de supuestos, ejecución de la prueba, lectura de las tablas de output, cálculo de la d de Cohen (que SPSS no produce automáticamente), manejo de violaciones, y reporte de resultados en formato APA 7.ª edición. El tutorial utiliza el mismo conjunto de datos de tesis de las guías anteriores de esta serie, por lo que las variables y la estructura de datos te resultarán familiares si ya trabajaste con las guías de estadísticas descriptivas o de pruebas de normalidad.

Puntos clave:

- La prueba t de muestras independientes compara las medias de dos grupos separados en una variable dependiente continua

- Verifica siempre cuatro supuestos antes de interpretar resultados: independencia, VD continua, normalidad (por grupo) y homogeneidad de varianzas (test de Levene)

- Si el test de Levene es significativo (p < .05), lee los resultados de la fila "No se asumen varianzas iguales", que aplica la corrección de Welch

- SPSS no calcula la d de Cohen automáticamente. Calcúlala manualmente desde la tabla Estadísticas de grupo usando: d = (M1 - M2) / DE combinada

- Reporta el estadístico t, grados de libertad, valor p, medias, desviaciones estándar y tamaño del efecto en tu capítulo de Resultados

Antes de comenzar: Esta guía asume que tienes tus datos cargados en SPSS con las variables definidas en Vista de variables. Deberías haber verificado previamente la normalidad de tu variable dependiente dentro de cada grupo. Si no lo has hecho, consulta nuestra guía sobre cómo verificar la normalidad en SPSS.

Cuándo Usar una Prueba T de Muestras Independientes

La prueba t de muestras independientes es apropiada cuando tu diseño de investigación cumple estas condiciones:

- Tienes una variable dependiente continua (por ejemplo, satisfacción, calificaciones, ingresos).

- Tienes una variable independiente categórica con exactamente dos grupos (por ejemplo, género, tratamiento/control, aprobado/reprobado).

- Las observaciones en cada grupo provienen de participantes diferentes (ningún participante aparece en ambos grupos).

Si tienes tres o más grupos, usa ANOVA de una vía en su lugar. Si los mismos participantes se miden dos veces (pre-test y post-test), usa una prueba t de muestras pareadas.

Ejemplos comunes en tesis:

| Pregunta de Investigación | Variable Dependiente | Variable de Agrupación |

|---|---|---|

| ¿Difieren hombres y mujeres en satisfacción? | Satisfacción (continua) | Género (hombre/mujer) |

| ¿El programa de capacitación mejora las calificaciones? | Calificación (continua) | Grupo (tratamiento/control) |

| ¿Difieren los encuestados urbanos y rurales en ingresos? | Ingreso mensual (continua) | Ubicación (urbano/rural) |

Tabla 1: Diseños de investigación comunes adecuados para la prueba t de muestras independientes

Supuestos

La prueba t de muestras independientes tiene cuatro supuestos. Las violaciones no invalidan automáticamente tus resultados, pero necesitas verificar cada uno y documentar lo que encontraste.

1. Independencia de Observaciones

Cada participante aporta datos a un solo grupo. Un estudiante no puede estar en el grupo "hombre" y en el grupo "mujer" al mismo tiempo. Este supuesto se cumple a través del diseño de investigación, no mediante una prueba estadística. Si tus datos involucran mediciones repetidas de los mismos participantes, necesitas una prueba t de muestras pareadas o un diseño de medidas repetidas.

2. Variable Dependiente Continua

La variable dependiente debe medirse en una escala de intervalo o de razón. Las puntuaciones de satisfacción en una escala Likert de 1 a 5 generalmente se tratan como continuas en la investigación en ciencias sociales, aunque este es un punto de debate. Si tu variable dependiente es una escala compuesta (promedio de varios ítems), verifica su fiabilidad con Alfa de Cronbach antes de usarla en la prueba t. Los datos ordinales con pocas categorías (por ejemplo, una escala de acuerdo de 1 a 3) se analizan mejor con la prueba U de Mann-Whitney.

3. Normalidad Dentro de Cada Grupo

La variable dependiente debe tener una distribución aproximadamente normal dentro de cada grupo, no en la muestra total. Esta es una distinción crítica. Dos grupos pueden ser no normales individualmente mientras la distribución combinada parece normal, y viceversa.

Para verificar esto, usa el procedimiento Explorar con la variable de agrupación en la Lista de factores. La guía de pruebas de normalidad enlazada en el recuadro de prerrequisitos cubre esto en detalle, incluyendo cómo usar la Lista de factores para separar por grupo.

La prueba t es robusta ante violaciones moderadas de normalidad cuando cada grupo tiene 30 o más casos (Schmider et al., 2010). Con grupos más pequeños, revisa cuidadosamente los gráficos Q-Q y considera la prueba U de Mann-Whitney si la desviación es severa.

4. Homogeneidad de Varianzas (Test de Levene)

Los dos grupos deben tener varianzas aproximadamente iguales (dispersión de puntuaciones). SPSS verifica esto automáticamente usando el test de Levene, que aparece en el output de la prueba t. No necesitas ejecutarlo por separado.

Si el test de Levene es no significativo (p > .05): las varianzas son aproximadamente iguales. Lee los resultados de la fila "Se asumen varianzas iguales".

Si el test de Levene es significativo (p < .05): las varianzas son desiguales. Lee los resultados de la fila "No se asumen varianzas iguales", que usa la corrección de Welch para ajustar los grados de libertad y el valor p. Esto no invalida el análisis. La prueba t de Welch maneja bien las varianzas desiguales, y algunos metodólogos recomiendan reportarla por defecto (Delacre et al., 2017).

Conjunto de Datos de Ejemplo

Este tutorial utiliza el mismo conjunto de datos de tesis de las guías de estadísticas descriptivas y normalidad. Puedes descargarlo desde la barra lateral. La pregunta de investigación para este análisis:

¿Difieren los estudiantes hombres y mujeres en sus puntuaciones de satisfacción?

- Variable dependiente: Satisfacción (continua, Escala, 1.00 a 5.00)

- Variable de agrupación: Género (nominal, 1 = Hombre, 2 = Mujer)

- Muestra: 147 casos válidos (61 hombres, 86 mujeres)

De la guía de normalidad, sabemos que Satisfacción tiene una asimetría de -0.48 y curtosis de -0.41 (ambas dentro del rango de -1 a +1). La prueba de Shapiro-Wilk fue significativa (p = .003) debido al tamaño de la muestra, pero la desviación práctica es despreciable. Los datos son adecuados para una prueba paramétrica.

Paso a Paso: Ejecución de la Prueba T de Muestras Independientes

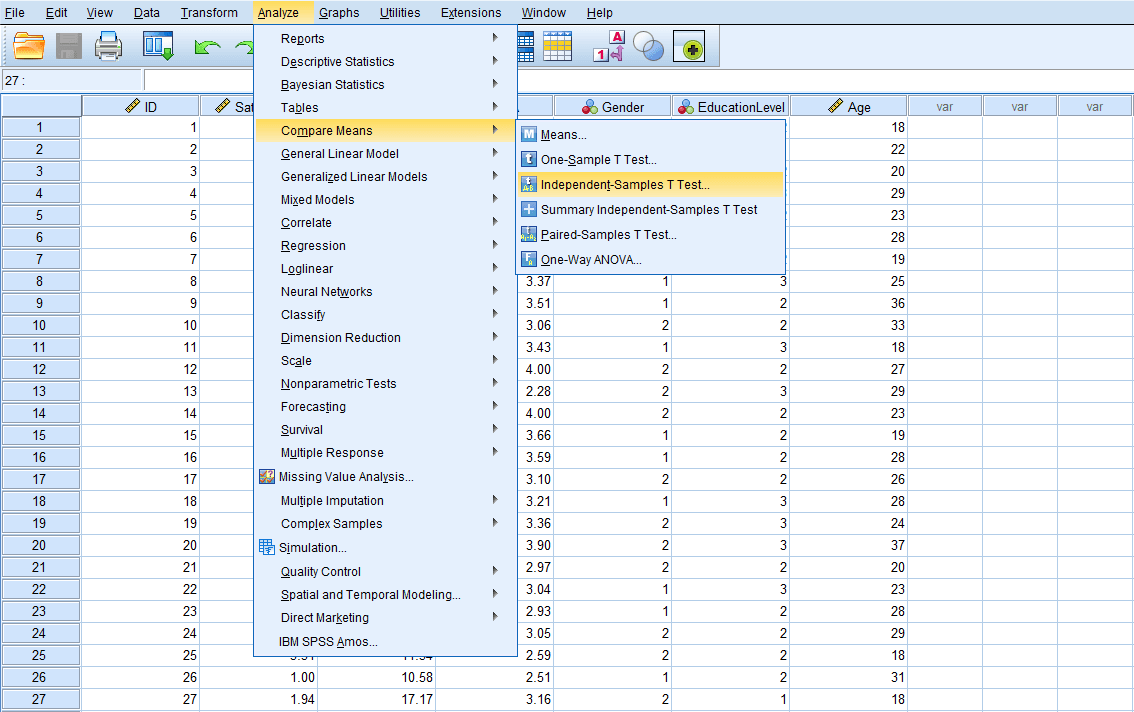

Paso 1: Navega al Cuadro de Diálogo de la Prueba T

Ve a Analizar > Comparar medias > Prueba T para muestras independientes.

Figura 1: Navega a Analizar > Comparar medias > Prueba T para muestras independientes

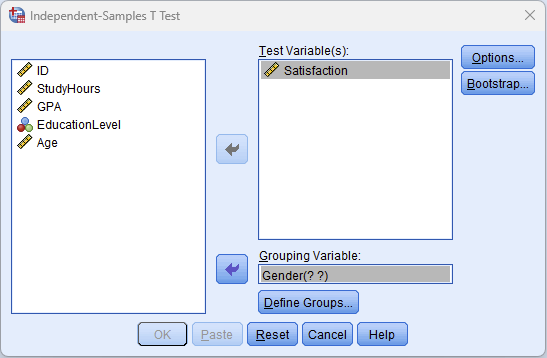

Paso 2: Configura las Variables

En el cuadro de diálogo Prueba T para muestras independientes:

- Mueve Satisfacción al cuadro Variable(s) de prueba. Esta es tu variable dependiente. Puedes agregar múltiples variables de prueba para ejecutar varias pruebas t a la vez, pero cada una se evaluará contra la misma variable de agrupación.

- Mueve Género al cuadro Variable de agrupación. Verás "Género(? ?)" indicando que SPSS necesita que definas qué valores representan los dos grupos.

Figura 2: Cuadro de diálogo de Prueba T para muestras independientes con Satisfacción como variable de prueba y Género como variable de agrupación

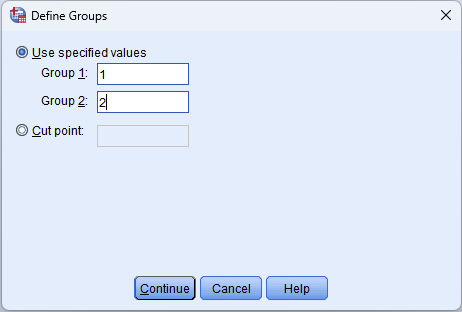

Paso 3: Define los Grupos

Haz clic en el botón Definir grupos. Ingresa los valores que representan tus dos grupos:

- Grupo 1: 1 (Hombre)

- Grupo 2: 2 (Mujer)

Estos valores deben coincidir con los códigos en tus datos. Revisa la Vista de variables si no estás seguro de qué códigos numéricos representan cada categoría.

Haz clic en Continuar para volver al cuadro de diálogo principal.

Figura 3: Cuadro de diálogo Definir grupos: Grupo 1 = 1 (Hombre), Grupo 2 = 2 (Mujer)

Paso 4: Ejecuta la Prueba

Haz clic en Aceptar. SPSS produce dos tablas de output: la tabla Estadísticas de grupo y la tabla Prueba de muestras independientes.

Interpretación del Output

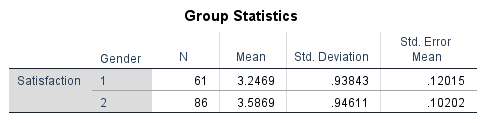

Tabla Estadísticas de Grupo

Esta tabla reporta las estadísticas descriptivas para cada grupo por separado.

Figura 4: Tabla Estadísticas de grupo con estadísticas descriptivas de hombres y mujeres en Satisfacción

Qué observar:

- N: Tamaño de muestra por grupo (61 hombres, 86 mujeres). Los tamaños desiguales son aceptables.

- Media: La puntuación promedio de Satisfacción para cada grupo. Compáralas para ver la dirección de cualquier diferencia.

- Desv. Estándar: La dispersión de puntuaciones dentro de cada grupo. Desviaciones estándar similares sugieren varianzas iguales; valores muy diferentes sugieren un posible problema con el test de Levene.

- Error estándar de la media: El error estándar de la media de cada grupo. Valores más pequeños indican estimaciones más precisas.

Antes de pasar a la prueba inferencial, anota las medias y desviaciones estándar. Las necesitarás para el reporte APA y para calcular la d de Cohen.

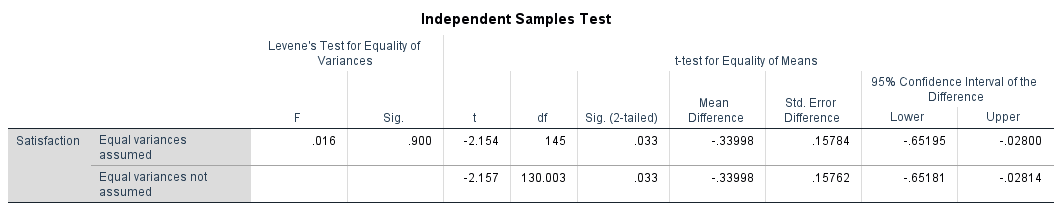

Tabla Prueba de Muestras Independientes

Esta es la tabla principal de resultados. Contiene el test de Levene y los resultados de la prueba t en una sola tabla.

Figura 5: Tabla Prueba de muestras independientes con test de Levene para igualdad de varianzas y resultados de la prueba t

La lectura de la tabla requiere dos pasos:

Paso A: Verifica el test de Levene (lado izquierdo de la tabla)

Observa las columnas "Prueba de Levene de igualdad de varianzas" (F y Sig.).

- Si Sig. > .05: Las varianzas son iguales. Lee la fila superior ("Se asumen varianzas iguales").

- Si Sig. < .05: Las varianzas son desiguales. Lee la fila inferior ("No se asumen varianzas iguales").

Paso B: Lee los resultados de la prueba t (lado derecho de la tabla, desde la fila correcta)

- t: El estadístico t. Su valor absoluto indica cuántos errores estándar separan las medias de los grupos.

- gl: Grados de libertad. Para varianzas iguales asumidas, gl = N1 + N2 - 2. Para la prueba t de Welch, gl se ajusta y frecuentemente no es un número entero.

- Sig. (bilateral): El valor p. Si este está por debajo de tu nivel alfa (generalmente .05), la diferencia entre grupos es estadísticamente significativa.

- Diferencia de medias: La diferencia bruta entre las medias de los dos grupos (M1 - M2).

- Error estándar de la diferencia: El error estándar de esa diferencia.

- Intervalo de confianza del 95%: El rango dentro del cual probablemente se encuentra la verdadera diferencia de medias poblacional. Si este intervalo contiene cero, la diferencia no es significativa.

Integración del Output

En este ejemplo, el test de Levene tiene F = 0.016, Sig. = .900 (no significativo). Esto significa que las varianzas son aproximadamente iguales, por lo que leemos la fila superior ("Se asumen varianzas iguales").

La prueba t muestra: t(145) = -2.154, p = .033, Diferencia de medias = -0.34.

El resultado es estadísticamente significativo. Las mujeres (M = 3.59, DE = 0.95) obtuvieron puntuaciones significativamente más altas que los hombres (M = 3.25, DE = 0.94) en Satisfacción. El intervalo de confianza del 95% para la diferencia de medias [-0.65, -0.03] no contiene cero, confirmando el resultado significativo.

Observa que el intervalo de confianza es relativamente amplio comparado con la diferencia de medias en sí. Esto nos indica que la estimación tiene cierta incertidumbre, aunque podemos estar seguros de que la verdadera diferencia es negativa (las mujeres puntúan más alto). La importancia práctica de una diferencia de 0.34 puntos en una escala de 5 puntos requiere contexto, que es donde entra la d de Cohen.

Cálculo de la d de Cohen (Tamaño del Efecto)

SPSS no calcula la d de Cohen para la prueba t de muestras independientes. Necesitas calcularla manualmente. Los comités de tesis esperan cada vez más que se reporten tamaños del efecto junto con los valores p, porque un resultado no significativo con una muestra pequeña no necesariamente significa que no existe efecto, y un resultado significativo con una muestra grande no necesariamente significa que el efecto sea relevante.

Fórmula

Donde la desviación estándar combinada es:

Ejemplo de Cálculo

Usando los valores de la tabla Estadísticas de grupo:

- (Hombre) = 3.2469, = 0.93843, = 61

- (Mujer) = 3.5869, = 0.94611, = 86

Interpretación

| d de Cohen | Tamaño del Efecto | Significado Práctico |

|---|---|---|

| 0.2 | Pequeño | La diferencia existe pero es difícil de observar |

| 0.5 | Mediano | La diferencia es notoria y puede ser prácticamente relevante |

| 0.8 | Grande | La diferencia es sustancial y claramente significativa |

Tabla 2: Criterios de la d de Cohen para interpretar el tamaño del efecto (Cohen, 1988)

En este ejemplo, d = 0.36 es un efecto de pequeño a mediano. Las mujeres obtuvieron aproximadamente un tercio de desviación estándar más que los hombres en Satisfacción. Combinado con el valor p significativo (.033), este resultado proporciona evidencia tanto estadística como práctica de una diferencia de género, aunque el efecto es modesto en lugar de dramático.

El signo de la d de Cohen indica dirección (negativo significa que el Grupo 2 puntuó más alto), pero la magnitud es lo que importa para la interpretación. Reporta el valor absoluto si la dirección es clara a partir de las medias.

Qué Hacer Cuando se Violan los Supuestos

Violación de Normalidad

Si la normalidad se viola severamente (asimetría más allá de +/-2 dentro de uno o ambos grupos) y los tamaños de tus grupos son menores a 30, la prueba U de Mann-Whitney es la alternativa no paramétrica estándar. Compara los rangos de las puntuaciones en lugar de las medias y no requiere normalidad.

Para ejecutar la prueba U de Mann-Whitney en SPSS: Analizar > Pruebas no paramétricas > Cuadros de diálogo antiguos > 2 muestras independientes. Mueve la variable de prueba a la Lista de variables de prueba, la variable de agrupación al cuadro Variable de agrupación, define los grupos y selecciona "U de Mann-Whitney" en Tipo de prueba.

Con grupos de 30 o más, las pruebas t paramétricas son lo suficientemente robustas como para que las violaciones moderadas de normalidad (asimetría entre -2 y +2) generalmente no afecten la validez de los resultados (Glass et al., 1972). Documenta la violación y cita la literatura sobre robustez.

Varianzas Desiguales (Test de Levene Significativo)

Esta es la violación más fácil de manejar. Lee la fila "No se asumen varianzas iguales" en el output. La prueba t de Welch ajusta los grados de libertad para compensar las varianzas desiguales. No se necesita una prueba adicional.

Repórtalo de forma transparente: "El test de Levene indicó varianzas desiguales, F(1, 145) = 5.23, p = .024. Por lo tanto, se utilizó la prueba t con ajuste de Welch."

Ambos Supuestos Violados

Cuando se violan tanto la normalidad como la igualdad de varianzas, la prueba U de Mann-Whitney es la opción más segura. Reporta la violación, explica por qué elegiste la alternativa no paramétrica, y presenta los resultados de la prueba U de Mann-Whitney usando formato APA.

Reporte en Formato APA

Reporte de los Resultados Reales de Este Tutorial

Se condujo una prueba t de muestras independientes para comparar las puntuaciones de Satisfacción entre estudiantes hombres y mujeres. El test de Levene de igualdad de varianzas no fue significativo (F = 0.02, p = .900), por lo que se asumieron varianzas iguales. Las estudiantes mujeres (M = 3.59, DE = 0.95) reportaron una satisfacción significativamente mayor que los estudiantes hombres (M = 3.25, DE = 0.94), t(145) = -2.15, p = .033, d = 0.36, IC 95% [-0.65, -0.03]. El tamaño del efecto fue de pequeño a mediano.

Plantilla para Resultado No Significativo

Si el resultado hubiera sido no significativo, el reporte seguiría esta estructura:

Se condujo una prueba t de muestras independientes para comparar las puntuaciones de Satisfacción entre estudiantes hombres y mujeres. No hubo diferencia significativa entre hombres (M = 3.25, DE = 0.94) y mujeres (M = 3.38, DE = 0.96), t(145) = -0.84, p = .401, d = 0.14. El tamaño del efecto fue despreciable.

Con Corrección de Welch (Varianzas Desiguales)

El test de Levene indicó varianzas desiguales (F = 5.23, p = .024), por lo que se utilizó la prueba t con ajuste de Welch. No hubo diferencia significativa entre hombres (M = 3.12, DE = 0.89) y mujeres (M = 3.24, DE = 1.12), t(141.35) = -0.72, p = .474, d = 0.12.

Formato de Tabla APA

Para capítulos de Resultados de tesis que requieren una tabla resumen:

| Variable | Grupo | N | M | DE | t | gl | p | d |

|---|---|---|---|---|---|---|---|---|

| Satisfacción | Hombre | 61 | 3.25 | 0.94 | -2.15 | 145 | .033 | 0.36 |

| Mujer | 86 | 3.59 | 0.95 |

Tabla 3: Resultados de la prueba t de muestras independientes comparando Satisfacción por Género

Lista de Verificación para el Reporte

Todo reporte de prueba t de muestras independientes debe incluir:

- El propósito de la prueba (qué comparación se hizo y por qué)

- El resultado del test de Levene (varianzas iguales o desiguales, y qué fila se leyó)

- Las medias y desviaciones estándar de cada grupo

- El estadístico t, los grados de libertad y el valor p exacto

- El tamaño del efecto (d de Cohen) con interpretación

- El intervalo de confianza del 95% de la diferencia de medias (opcional pero recomendado)

Errores Comunes

1. Usar la Prueba T para Tres o Más Grupos

Ejecutar múltiples pruebas t de muestras independientes para comparar tres grupos (por ejemplo, Preparatoria vs. Licenciatura, Preparatoria vs. Maestría, Licenciatura vs. Maestría) infla la tasa de error Tipo I. Con tres comparaciones por pares a un alfa de .05, la probabilidad de al menos un falso positivo aumenta a aproximadamente .14. Usa ANOVA de una vía con pruebas post-hoc en su lugar.

2. Ignorar el Test de Levene

Algunos estudiantes reportan solo la fila "Se asumen varianzas iguales" sin verificar si ese supuesto se cumple. Si el test de Levene es significativo, los grados de libertad, el valor p y el intervalo de confianza en la fila superior son incorrectos. Siempre verifica y reporta qué fila utilizaste.

3. No Verificar la Normalidad por Grupo

Ejecutar una sola prueba de normalidad sobre la variable completa (ambos grupos combinados) es insuficiente. El supuesto requiere normalidad dentro de cada grupo. Usa la Lista de factores en el procedimiento Explorar para probar cada grupo por separado.

4. Omitir el Tamaño del Efecto

Un valor p te indica si el resultado es estadísticamente significativo, pero no si la diferencia es lo suficientemente grande como para importar. Un resultado significativo con d = 0.10 y una muestra de 500 es estadísticamente significativo pero prácticamente irrelevante. Los comités esperan cada vez más la d de Cohen u otra medida de tamaño del efecto.

5. Confundir Diseños Independientes y Pareados

Si los mismos participantes se miden antes y después de una intervención, las observaciones no son independientes. Usar la prueba t de muestras independientes en esta situación ignora la correlación entre las mediciones pareadas y produce resultados incorrectos. Usa la prueba t de muestras pareadas para comparaciones intra-sujetos.

6. Ejecutar Pruebas Unilaterales Sin Justificación

SPSS reporta valores p bilaterales por defecto. Dividir el valor p entre 2 para obtener un resultado unilateral solo es apropiado cuando tienes una hipótesis direccional sólida establecida antes de la recolección de datos. Cambiar a una prueba unilateral después de ver los datos para alcanzar significancia es una forma de p-hacking que los comités cuestionarán.

Lo Que tu Comité de Tesis Preguntará

"¿Por qué usaste una prueba t de muestras independientes y no ANOVA?" Explica que la prueba t de muestras independientes es la prueba apropiada cuando se comparan exactamente dos grupos en un resultado continuo. ANOVA está diseñada para tres o más grupos. Aunque ANOVA de una vía con dos grupos produce resultados matemáticamente idénticos (F = t²), la prueba t aborda directamente la comparación de dos grupos y es la elección convencional. Si tu pregunta de investigación involucra predecir una variable a partir de otra, la regresión lineal es el método indicado.

"¿Cómo manejaste el supuesto de varianzas iguales?" Describe que verificaste el test de Levene en el output de SPSS. Si no fue significativo, se asumieron varianzas iguales. Si fue significativo, usaste los resultados ajustados por Welch de la fila "No se asumen varianzas iguales". Cita a Delacre et al. (2017) si tu comité cuestiona este enfoque.

"El resultado es significativo, pero ¿es la diferencia prácticamente importante?" Aquí es donde entra la d de Cohen. Una d de 0.36 es un efecto de pequeño a mediano: las mujeres obtuvieron aproximadamente un tercio de desviación estándar más que los hombres. Si esto importa depende del contexto de investigación. En una encuesta de satisfacción con escala de 1 a 5, una diferencia de 0.34 puntos puede o no ser prácticamente significativa. Reporta el tamaño del efecto, describe su magnitud usando los criterios de Cohen, y permite que el lector evalúe la relevancia para su contexto específico.

"¿Por qué debo confiar en la prueba t si la prueba de Shapiro-Wilk fue significativa?" Hace referencia a la distinción entre significancia estadística e importancia práctica en las pruebas de normalidad. Cita los valores de asimetría y curtosis (dentro de +/-1), la evidencia de los gráficos Q-Q, y la literatura sobre robustez (Schmider et al., 2010). Esta pregunta se aborda en profundidad en la guía de pruebas de normalidad.

Preguntas Frecuentes

Próximos Pasos

Si tu diseño involucra a los mismos participantes medidos en dos momentos (por ejemplo, pre-test y post-test), la prueba t de muestras pareadas es la prueba indicada. Mientras que la prueba t de muestras independientes compara grupos distintos, la versión pareada aprovecha la correlación entre mediciones repetidas para obtener mayor potencia estadística.

Para examinar la relación entre dos variables continuas en lugar de comparar medias entre grupos, la regresión lineal múltiple proporciona un marco para predicción y explicación que permite controlar múltiples predictores simultáneamente.

Referencias

American Psychological Association. (2020). Publication manual of the American Psychological Association (7th ed.). American Psychological Association.

Cohen, J. (1988). Statistical power analysis for the behavioral sciences (2nd ed.). Lawrence Erlbaum Associates.

Delacre, M., Lakens, D., & Leys, C. (2017). Why psychologists should by default use Welch's t-test instead of Student's t-test. International Review of Social Psychology, 30(1), 92-101.

Field, A. (2018). Discovering statistics using IBM SPSS statistics (5th ed.). SAGE Publications.

Glass, G. V., Peckham, P. D., & Sanders, J. R. (1972). Consequences of failure to meet assumptions underlying the fixed effects analyses of variance and covariance. Review of Educational Research, 42(3), 237-288.

Pallant, J. (2020). SPSS survival manual (7th ed.). Open University Press.

Schmider, E., Ziegler, M., Danay, E., Beyer, L., & Bühner, M. (2010). Is it really robust? Reinvestigating the robustness of ANOVA against violations of the normal distribution assumption. Methodology, 6(4), 147-151.