La homocedasticidad es un supuesto fundamental en la regresión lineal y el modelado estadístico. Comprender qué significa la homocedasticidad (varianza constante de los residuos) es esencial para producir resultados estadísticos válidos y confiables.

Esta guía explica el supuesto de homocedasticidad en estadística, cómo reconocer violaciones (heterocedasticidad) y soluciones prácticas. Aprenderás la diferencia clave entre homocedasticidad vs heterocedasticidad y por qué violar este supuesto produce pruebas de hipótesis e intervalos de confianza poco confiables en el análisis de regresión.

¿Qué es el Supuesto de Homocedasticidad?

Homocedasticidad (pronunciada "homo-cedas-ti-ci-dad") describe la varianza constante de los residuos o errores en todos los niveles de las variables independientes de un conjunto de datos.

Definición: En un conjunto de datos homocedástico, la dispersión de los puntos de datos permanece consistente sin importar los valores de la variable predictora. La varianza no cambia al cambiar la variable independiente.

Ejemplo: En un examen de clase, si la variabilidad de las calificaciones es similar para todos los niveles de habilidad, eso es homocedasticidad. Todos los estudiantes muestran una dispersión de calificaciones similar sin importar su nivel de competencia.

Heterocedasticidad (lo opuesto) ocurre cuando la varianza cambia entre los niveles de la variable independiente. En el ejemplo del examen, la varianza podría ser mayor para los estudiantes avanzados y menor para los principiantes. La dispersión no es constante.

Homocedasticidad y Regresión Lineal

La homocedasticidad es un supuesto fundamental en la regresión lineal por varias razones:

-

Eficiencia de los estimadores: Cuando se cumple la homocedasticidad, los mínimos cuadrados ordinarios (OLS) proporcionan el mejor estimador lineal insesgado (BLUE) con la menor varianza. La heterocedasticidad hace que los estimadores OLS sean ineficientes.

-

Validez de las pruebas de hipótesis: Las pruebas de hipótesis (pruebas t, pruebas F) asumen homocedasticidad. Las violaciones producen estadísticos de prueba y valores p poco confiables, causando conclusiones incorrectas sobre la significancia de los coeficientes.

-

Intervalos de confianza: Los datos homocedásticos producen intervalos de confianza precisos. La heterocedasticidad crea intervalos demasiado amplios o estrechos, generando inferencias incorrectas.

-

Precisión predictiva: Con varianza constante, las predicciones del modelo son consistentemente confiables en todos los niveles de los predictores. La heterocedasticidad compromete la precisión predictiva a medida que la variabilidad residual cambia.

Cómo Reconocer la Homocedasticidad (y la Heterocedasticidad)

Una vez que entiendes qué es la homocedasticidad y por qué es importante, el siguiente paso es aprender a identificarla en tus datos. Existen varias formas de verificar la homocedasticidad, incluyendo métodos gráficos y pruebas estadísticas.

Métodos Gráficos

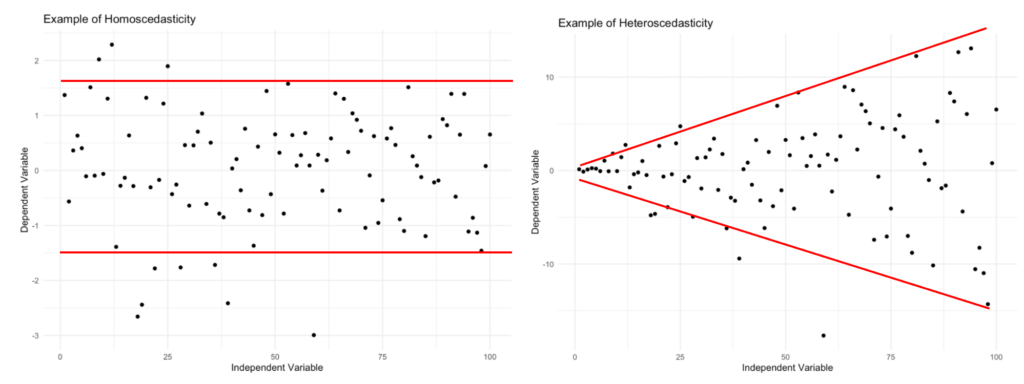

Crea un gráfico de dispersión de los residuos contra los valores ajustados. En datos homocedásticos, los puntos deben estar dispersos uniformemente sin patrones ni agrupaciones visibles.

Figura 1: Homocedasticidad vs. heterocedasticidad: varianza constante (izquierda) versus varianza cambiante (derecha).

Pruebas Estadísticas

Si prefieres un enfoque más formal, existen varias pruebas estadísticas para verificar la homocedasticidad. Algunas pruebas populares incluyen:

-

Prueba de Bartlett: Verifica varianzas iguales en múltiples grupos. Resultados significativos indican heterocedasticidad.

-

Prueba de Levene: Similar a la prueba de Bartlett, la prueba de Levene verifica varianzas iguales entre grupos. Es menos sensible a la falta de normalidad, lo que la hace más robusta.

-

Prueba de Breusch-Pagan: Utilizada en el análisis de regresión. Evalúa si los residuos al cuadrado se relacionan con las variables independientes. Resultados significativos indican heterocedasticidad.

-

Prueba de White: Prueba más general para la heterocedasticidad en regresión. Examina si los residuos al cuadrado se relacionan con combinaciones lineales o cuadráticas de las variables independientes.

Ten en cuenta que ninguna prueba es perfecta y cada una tiene sus limitaciones. En algunos casos, puede ser útil usar múltiples pruebas o combinarlas con métodos gráficos para obtener una evaluación más precisa de la homocedasticidad.

Cómo Abordar la Heterocedasticidad

Si descubres que tus datos son heterocedásticos, existen varias estrategias para abordar este problema:

-

Transformación: Transforma las variables (logaritmo, raíz cuadrada, recíproco) para estabilizar la varianza. Ten en cuenta que la transformación cambia la interpretación de los resultados.

-

Regresión ponderada: Asigna mayor peso a las observaciones con varianzas menores y menor peso a las varianzas mayores. Estabiliza la varianza en todo el rango de los predictores. Este método es particularmente útil en modelos de regresión múltiple donde la heterocedasticidad afecta distintas combinaciones de predictores.

-

Regresión robusta: Utiliza métodos menos sensibles a valores atípicos y violaciones de supuestos. Proporciona estimaciones más precisas con datos heterocedásticos.

-

Bootstrapping: Técnica de remuestreo que proporciona estimaciones precisas de los parámetros poblacionales incluso con heterocedasticidad.

Homocedasticidad vs. Heterocedasticidad: Diferencias Clave

| Aspecto | Homocedasticidad | Heterocedasticidad |

|---|---|---|

| Varianza | Constante en todos los niveles del predictor | Cambia entre niveles del predictor |

| Patrón visual | Dispersión aleatoria, sin patrones | Forma de embudo o abanico |

| Eficiencia OLS | BLUE (Mejor Estimador Lineal Insesgado) | Ineficiente, errores estándar mayores |

| Pruebas de hipótesis | Valores p e intervalos de confianza válidos | Valores p poco confiables, inferencias incorrectas |

| Impacto | Resultados confiables | Errores estándar sesgados, pruebas engañosas |

Tabla 1: Comparación entre homocedasticidad y heterocedasticidad en regresión lineal.

Preguntas Frecuentes

Próximos Pasos

La homocedasticidad (varianza constante de los residuos) es un supuesto fundamental en la regresión lineal y muchas pruebas estadísticas. Violar este supuesto produce errores estándar poco confiables, pruebas de hipótesis inválidas e intervalos de confianza incorrectos. Verificar este supuesto antes de interpretar tus resultados es un paso esencial en cualquier análisis de regresión.

Si necesitas verificar otro supuesto fundamental de la regresión, consulta nuestra guía sobre qué es la linealidad en estadística. Para aprender a evaluar la normalidad de tus datos antes de aplicar pruebas paramétricas, revisa cómo realizar la prueba de normalidad en R.

Referencias

Breusch, T. S., & Pagan, A. R. (1979). A simple test for heteroscedasticity and random coefficient variation. Econometrica, 47(5), 1287-1294.

Levene, H. (1960). Robust tests for equality of variances. In I. Olkin (Ed.), Contributions to Probability and Statistics (pp. 278-292). Stanford University Press.

White, H. (1980). A heteroskedasticity-consistent covariance matrix estimator and a direct test for heteroskedasticity. Econometrica, 48(4), 817-838.